Kemajuan cepat kecerdasan buatan (AI) menghasut orang untuk mempertanyakan apa batasan dasar teknologi. Semakin, masalah yang pernah dikirim ke fiksi ilmiah, gagasan tentang pengawas, sekarang secara serius dipertimbangkan oleh para ilmuwan dan ahli secara setara.

Gagasan bahwa mesin dapat bertepatan suatu hari atau bahkan mengatasi kecerdasan manusia memiliki sejarah panjang. Tetapi ritme kemajuan dalam AI selama dekade terakhir telah memberikan urgensi baru pada tema, terutama dari peluncuran model bahasa besar (LLM) yang kuat oleh perusahaan seperti Openai, Google dan Antrope, antara lain.

Para ahli memiliki sudut pandang yang sangat berbeda tentang seberapa layak gagasan “kecerdasan buatan” ini (seperti ini) dan ketika kelihatannya, tetapi beberapa menyarankan bahwa mesin yang sangat tinggi seperti itu hanya sekitar sudut. Yang pasti adalah bahwa, dan ketika muncul demikian, itu akan memiliki implikasi yang sangat besar untuk masa depan kemanusiaan.

“Saya pikir kita akan memasuki era baru penemuan ilmiah otomatis, pertumbuhan ekonomi yang sangat dipercepat, umur panjang dan pengalaman hiburan yang inovatif.” Tim RocktäschelProfesor AI di University College London dan seorang ilmuwan utama dari Google Deepmind mengatakan Live Science, yang memberikan pendapat pribadi alih -alih posisi resmi Google DeepMind. Namun, ia juga memperingatkan: “Seperti halnya teknologi yang signifikan dalam sejarah, ada risiko potensial.”

Apa itu pengawas buatan (seperti)?

Secara tradisional, penelitian AI telah berfokus pada replikasi kapasitas spesifik yang menunjukkan makhluk cerdas. Ini termasuk hal -hal seperti kemampuan untuk menganalisis adegan secara visual, menganalisis bahasa atau menavigasi lingkungan. Dalam beberapa domain sempit ini, AI telah mencapai kinerja manusia super, kata Rocktäschel, terutama di Game seperti Go and Chess.

Namun, tujuan peregangan untuk lapangan selalu untuk mereplikasi bentuk kecerdasan yang paling umum yang terlihat pada hewan dan manusia yang menggabungkan banyak kapasitas tersebut. Konsep ini telah melewati beberapa nama selama bertahun -tahun, termasuk “AI Strong” atau “Universal”, tetapi hari ini lebih umum disebut. Kecerdasan Umum Buatan (AGI).

“Untuk waktu yang lama, AGI telah menjadi bintang utara yang jauh untuk penyelidikan AI,” kata Rocktäschel. “Namun, dengan munculnya model mendasar [another term for LLMs] Sekarang kami memiliki AI yang dapat menyetujui berbagai ujian masuk ke universitas dan berpartisipasi dalam kompetisi matematika dan pengkodean internasional. “

Terkait: GPT-4.5 Ini adalah model AI pertama yang menyetujui uji gangguan otentik, kata para ilmuwan

Ini membuat orang menganggap kemungkinan AGI lebih serius, kata Rocktäschel. Dan yang terpenting, begitu kita membuat AI yang bertepatan dengan manusia dalam berbagai tugas, itu mungkin tidak menghabiskan banyak waktu sebelum kapasitas manusia super di semua bidang. Bagaimanapun, itulah idenya. “Begitu AI mencapai tingkat manusia, kita dapat menggunakannya untuk meningkatkan dengan cara yang merujuk diri sendiri,” kata Rocktäschel. “Secara pribadi saya pikir kita bisa sampai ke AGI, kita akan sampai sedikit, mungkin beberapa tahun setelah itu.”

Setelah tonggak itu tercapai, kita bisa melihat apa yang ahli matematika Inggris Irving John Good ditelepon “Ledakan Kecerdasan“Pada tahun 1965. Dia berpendapat bahwa begitu mesin menjadi cukup cerdas untuk meningkat, mereka akan dengan cepat mencapai tingkat intelijen jauh di luar manusia mana pun. Dia menggambarkan mesin ultra cerdas pertama sebagai” penemuan terakhir yang perlu dilakukan manusia. “

Futuristik terkenal Ray Kurzweil Dia berpendapat bahwa ini akan mengarah pada “keunikan teknologi” yang tiba -tiba akan mengubah peradaban manusia. Istilah ini menarik paralel dengan keunikan di jantung lubang hitam, di mana pemahaman kita tentang fisika pecah. Dengan cara yang sama, kedatangan dengan demikian akan mengarah pada pertumbuhan teknologi yang cepat dan tidak terduga yang akan berada di luar pemahaman kita.

Tepat ketika transisi seperti itu bisa terjadi masih bisa diperdebatkan. Pada tahun 2005, Kurzweil meramalkan bahwa AGI akan muncul pada tahun 2029, dengan keunikan yang mengikuti pada tahun 2045, sebuah prediksi yang telah terperangkap sejak saat itu. Pakar AI lainnya menawarkan prediksi yang sangat bervariasi, dari dekade ini tidak pernah. Tapi a survei terbaru Dari 2.778 peneliti dari AI menemukan bahwa, bersama -sama, mereka percaya bahwa ada kemungkinan 50% bahwa hal itu dapat muncul pada tahun 2047. a analisis yang lebih luas FBI bahwa sebagian besar ilmuwan sepakat bahwa AGI dapat tiba pada tahun 2040.

Apa artinya bagi kemanusiaan?

Implikasi dari teknologi seperti ini akan sangat besar, yang membuat para ilmuwan dan filsuf mendedikasikan banyak waktu untuk memetakan janji dan kemungkinan kesulitan bagi kemanusiaan.

Di sisi positif, mesin dengan kapasitas intelijen yang hampir tidak terbatas dapat menyelesaikan beberapa tantangan paling mendesak di dunia, katanya Daniel HulmeCEO Perusahaan AI Satalia Dan Konscium. Secara khusus, mesin super cerdas dapat “menghilangkan gesekan dari penciptaan dan penyebaran makanan, pendidikan, perawatan medis, energi, transportasi, sedemikian rupa sehingga kita dapat mengurangi biaya barang -barang itu menjadi nol,” katanya kepada Live Science.

Harapannya adalah bahwa ini akan membebaskan orang dari keharusan bekerja untuk bertahan hidup dan, di sisi lain, dapat menghabiskan waktu melakukan hal -hal yang penuh gairah, jelas Hulme. Tetapi kecuali jika sistem didirikan untuk mendukung mereka yang pekerjaannya menjadi berlebihan untuk AI, hasilnya bisa lebih suram. “Jika itu terjadi dengan sangat cepat, ekonomi kita mungkin tidak dapat menyeimbangkan kembali, dan dapat menyebabkan gangguan sosial,” katanya.

Ini juga mengasumsikan bahwa kita dapat mengendalikan dan mengarahkan entitas yang jauh lebih pintar daripada kita, sesuatu yang banyak ahli sarankan tidak mungkin. “Saya benar -benar tidak berlangganan gagasan ini bahwa itu akan berhati -hati dan menjaga kami dan memastikan kami bahagia,” kata Hulme. “Aku tidak bisa membayangkan apa yang peduli.”

Kemungkinan pengawasan superteligensi di mana kami tidak memiliki kendali telah menyebabkan kekhawatiran bahwa AI dapat menyajikan a Risiko eksistensial untuk spesies kita. Ini telah menjadi kiasan populer dalam fiksi ilmiah, dengan film -film seperti “Terminator” atau “The Matrix” yang menggambarkan mesin jahat yang berkomitmen untuk penghancuran umat manusia.

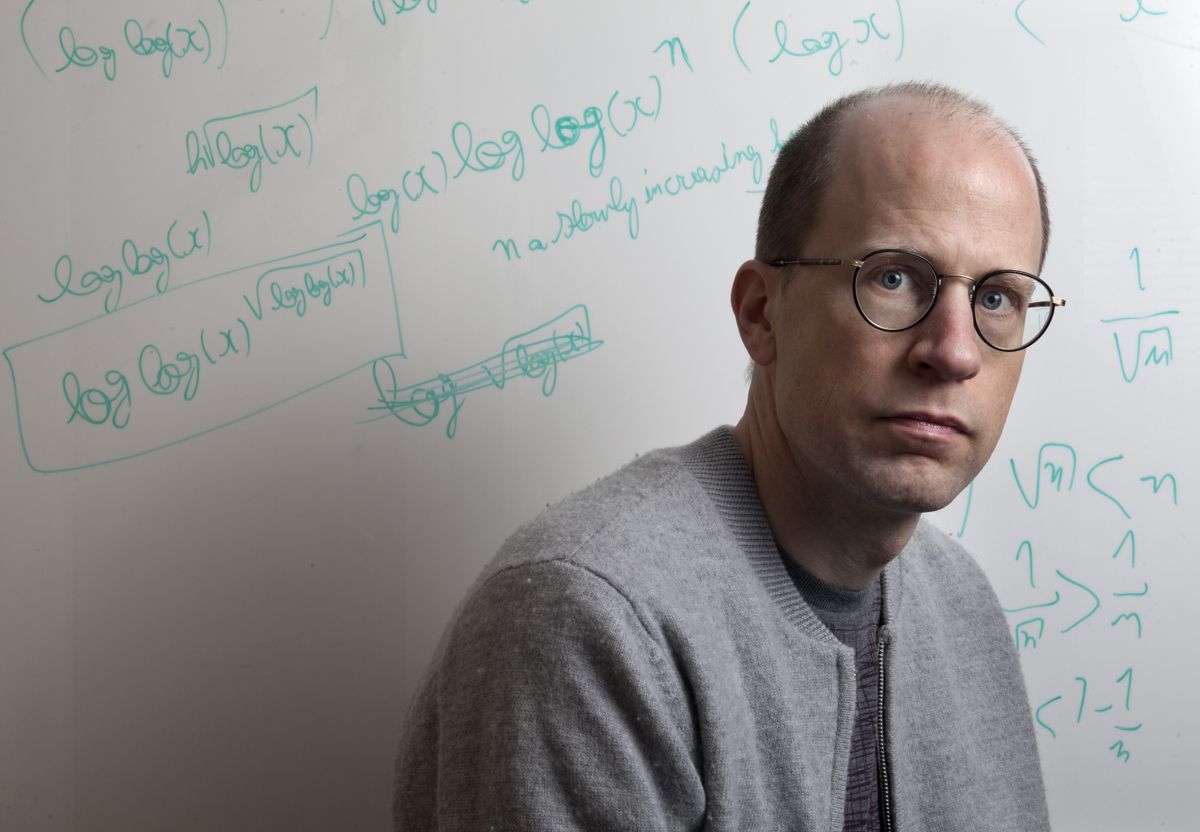

Tapi filsuf Nick Bostrom Dia menekankan bahwa seperti itu bahkan tidak harus secara aktif memusuhi manusia untuk mengembangkan beberapa skenario dari hari penilaian akhir. Di dalam Artikel 2012Dia menyarankan bahwa kecerdasan suatu entitas tidak tergantung pada tujuannya, sehingga dapat memiliki motivasi yang benar -benar asing bagi kita dan tidak selaras dengan kesejahteraan manusia.

Bostrom mengembangkan ide ini dengan percobaan mentalitas di mana modal super ditetapkan dalam tugas yang tampaknya tidak berbahaya untuk menghasilkan sebanyak mungkin klip. Jika mereka tidak selaras dengan nilai -nilai kemanusiaan, Anda dapat memutuskan untuk menghilangkan semua manusia untuk mencegah mereka mengajukan banding, atau yang dapat mengubah semua atom tubuh mereka menjadi lebih banyak klip.

Rocktäschel lebih optimis. “Kami membangun sistem AI saat ini agar berguna, tetapi juga asisten yang tidak berbahaya dan jujur berdasarkan desain,” katanya. “Mereka mendengarkan untuk mengikuti instruksi manusia dan dilatih dalam komentar untuk memberikan jawaban yang berguna, tidak berbahaya dan jujur.”

Sementara Rocktäschel mengakui bahwa perlindungan ini dapat dihindari, yakin bahwa kami akan mengembangkan pendekatan yang lebih baik di masa depan. Dia juga berpikir mungkin untuk menggunakan AI untuk mengawasi AI lain, bahkan jika mereka lebih kuat.

Hulme mengatakan bahwa sebagian besar pendekatan saat ini untuk “penyelarasan model”, upaya untuk memastikan bahwa AI selaras dengan nilai -nilai dan keinginan manusia, terlalu mentah. Mereka biasanya memberikan aturan tentang bagaimana model harus berperilaku atau melatihnya dalam contoh perilaku manusia. Tetapi dia berpikir bahwa pagar -pagar ini, yang kacau di akhir proses pelatihan, dapat dengan mudah mengabaikannya.

Sebaliknya, Hulme percaya bahwa kita harus membangun dengan “naluri moral.” Konkium perusahaannya berusaha melakukan AI yang berkembang di lingkungan virtual yang telah dirancang untuk menghargai perilaku seperti kerja sama dan altruisme. Saat ini, mereka bekerja dengan AI yang sangat sederhana, “di tingkat serangga”, tetapi jika pendekatan tersebut dapat diperluas, itu bisa membuat keselarasan lebih kuat. “Memperkirakan moralitas dalam naluri AI menempatkan kita pada posisi yang jauh lebih aman daripada sekadar memiliki rel pelindung Whiz-a-mole jenis ini,” kata Hulme.

Namun, tidak semua orang yakin bahwa kita perlu mulai khawatir. Kritik umum terhadap konsep seperti ini, kata Rocktäschel, adalah bahwa kita tidak memiliki contoh manusia yang sangat mampu dalam berbagai tugas, jadi ada kemungkinan bahwa tidak mungkin untuk mencapai ini dalam satu model. Keberatan lain adalah bahwa sumber daya komputasi yang diperlukan untuk mencapai sehingga dapat menjadi penghalang.

Lebih praktis, bagaimana kita mengukur kemajuan dalam AI dapat menipu seberapa dekat kita tentang pengawasan, katanya Alexander IlicKepala Pusat ETH AI di ETH Zurich, Swiss. Sebagian besar hasil yang mengesankan dalam AI dalam beberapa tahun terakhir berasal dari sistem percobaan dalam beberapa tes keterampilan individu yang sangat buatan, seperti pengkodean, penalaran atau pemahaman bahasa, bahwa sistem secara eksplisit dilatih untuk disetujui, kata Ilic.

Bandingkan ini dengan bahan makanan ujian di sekolah. “Anda memuat otak Anda untuk melakukannya, lalu Anda menulis tes dan kemudian melupakan segalanya,” katanya. “Kamu lebih pintar dengan menghadiri kelas, tetapi tes nyata itu sendiri bukan proksi pengetahuan nyata yang baik.”

AI yang mampu menghabiskan banyak tes ini di tingkat manusia super bisa hanya beberapa tahun lagi, kata Ilic. Tetapi dia percaya bahwa pendekatan dominan saat ini tidak akan mengarah pada model yang dapat melakukan tugas -tugas yang berguna di dunia fisik atau secara efektif berkolaborasi dengan manusia, yang akan sangat penting bagi mereka untuk memiliki dampak luas pada dunia nyata.